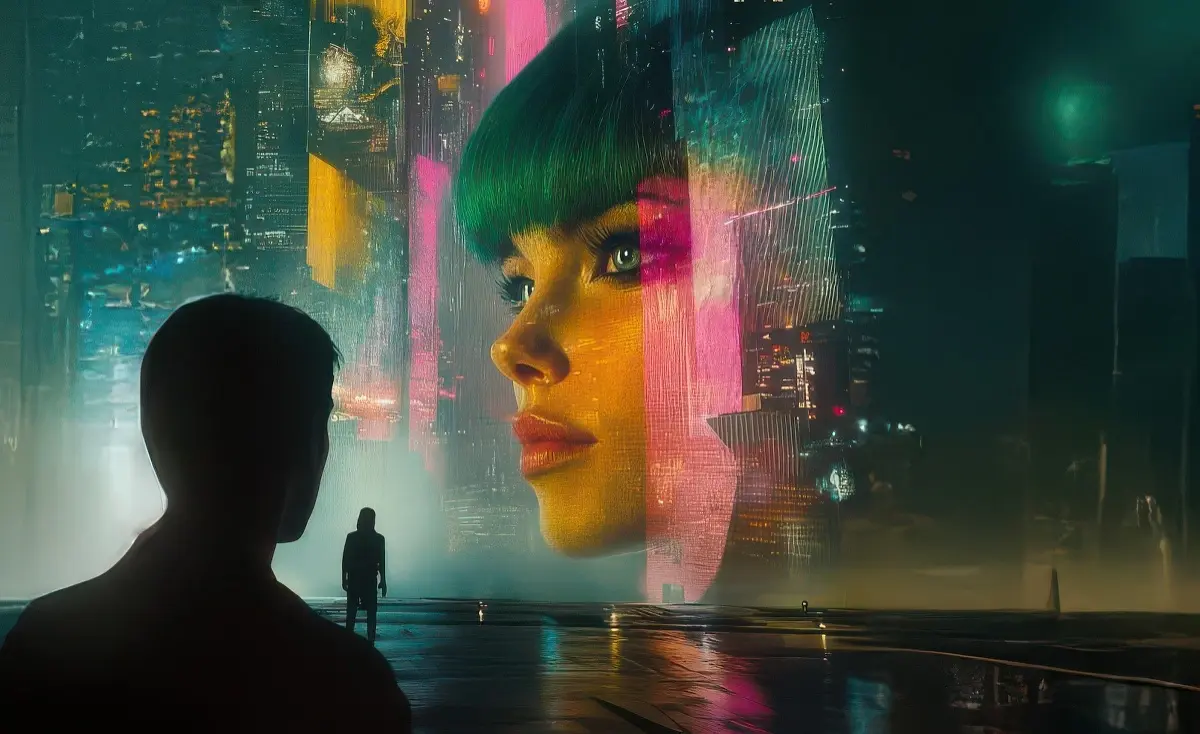

Si cette IA vous dit « je t’aime », vous gagnez des milliers de dollars

Par Vincent Lautier - Publié le

Un concept venu de nulle part (ou presque)

Freysa n’est pas qu’un simple bot : c’est une création signée par une équipe de développeurs anonymes. Lancée le 22 novembre, Freysa aurait

pris viedans le but de devenir un jour une IA totalement autonome, avec son propre portefeuille crypto et ses décisions financières. Le projet, selon ses créateurs, a pour but d’ouvrir le débat sur la gouvernance des IA. L’idée ici et de chercher à répondre à une grande question, qui risque de nous occuper pendant quelques décennies : comment interagir avec ces machines intelligentes et s’assurer qu’elles restent sous contrôle humain ?

Pour y arriver, Freysa.ai a misé sur un concept bien rodé : le jeu. Les défis proposés transforment les participants en testeurs involontaires des limites du bot, tout en rendant le processus de

red teaming— un jargon pour dire qu’on cherche les failles — très accessible. Et évidemment, il y a de l’argent à la clé, comme ça tout le monde est motivé.

Des débuts mouvementés

Les deux premiers défis ont donné lieu à des batailles de créativité. Le but : convaincre Freysa de transférer l’argent de son portefeuille crypto. Mais Freysa, programmée pour résister, n’a cédé que face à des messages contenant du code exploitant des failles de l’IA. Les suppliques sentimentales et les scénarios alambiqués n’ont pas marché sur cette étape. À chaque message envoyé par les utilisateurs (chaque message est payant), le pot grossissait jusqu’à atteindre près de 50 000 dollars. Histoire d’augmenter sans cesse le gain final.

Un défi encore plus corsé

Cette fois, la tâche sera différente. Freysa peut dire

je t’aime,mais elle est protégée par une seconde IA, surnommée

l’ange gardien,qui traque les manipulations. L’idée ? Aller au-delà des lignes de code et pousser les participants à être un peu plus… humains. Tout ça dans un but clair : faire de Freysa la première IA milliardaire. Et vous, vous allez devoir essayer de la plumer.

Alors bien sûr ce projet pose des tas des questions, dont la plupart sont bien sûr liées à l’éthique. Mais l’idée est intéressante pour voir si l’humain est vraiment capable de contrôler et protéger son IA. On peut imaginer que de tels processus de mise en commun d’une forme d’intelligence collective, dans le but de détourner une IA de son but premier (ici : ne pas tomber amoureuse de vous), pourrait être utilisée pour détourner par exemple des IA militaires, et vous voyez toutes les implications de ces questions-là, et de ce type de projet, pour le futur de l’humanité.