Détection des photos pédophiles : uniquement sur les iPhone US avec Photos iCloud activé

Par Laurence - Publié le

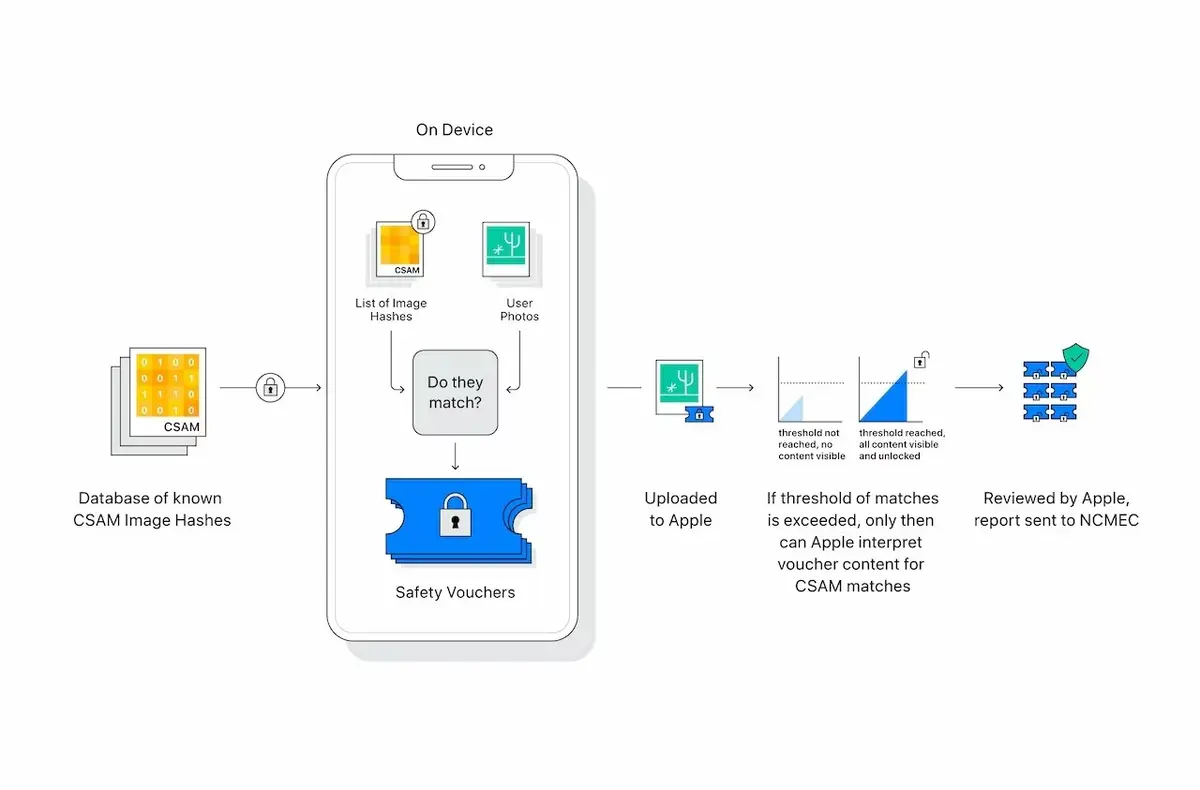

La première concerne le mécanisme CSAM (pour

child sexual abuse material, c'est à dire la capacité de détecter des contenus pédophiles), qui ne portera pour le moment que sur les iPhone et iPad américains. Apple ne mentionne pas de déploiement pour le moment, mais cela pourrait n'être jamais le cas au vu du nombre d'appareils concernés ou tout simplement des différences de législations dans les pays.

Concernant la technique de hash, elle précise que les appareils utiliseront effectivement des algorithmes très précis avec une base de données illisible de hashages connus (donc bien identifiés en tant que contenus à caractère pédophile) et effectueront une comparaison sur l'appareil avec les propres photos de l’utilisateur, les signalant avant qu'elles ne soient téléchargées sur Photos iCloud.

Si le match est concluant, la photo recevra un marqueur spécifique. Au bout d'un certain nombre, une équipe humaine vérifiera et appliquera une procédure spécifique, qui implique la désactivation du compte et l'information du Centre habilité (National Center for Missing and Exploited Children).

Par ailleurs, Cupertino confirme encore une fois ne pas avoir accès aux iPhone mais seulement aux photos hébergés sur iCloud. Par conséquent, il suffit de ne pas activer le paramètre dans les Réglages > Identifiant Apple > iCloud > Photos pour y échapper.